近日,机械与汽车工程学院张振副教授团队在视频技术领域的国际顶级期刊《IEEE Transactions on Circuits and Systems for Video Technology》(中科院一区TOP,IF=11.1)上发表了题为“CA-YOLO: Cross Attention Empowered YOLO for Biomimetic Localization”的最新研究成果。

该论文以安徽工程大学为第一完成单位,国防科技大学电子对抗学院为通讯单位,安徽工程大学张振副教授和研究生赵庆为共同第一作者,国防科技大学电子对抗学院张逸副教授为通讯作者。

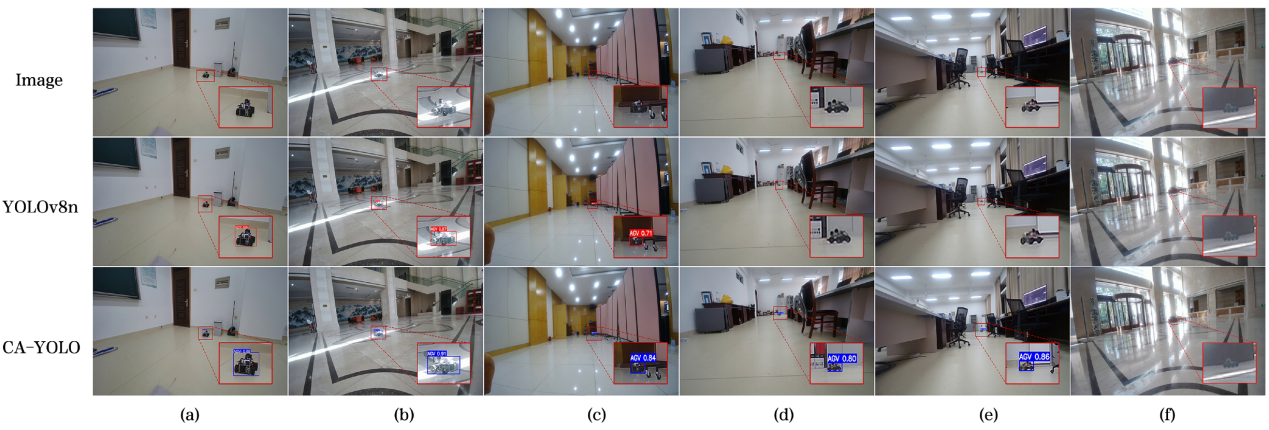

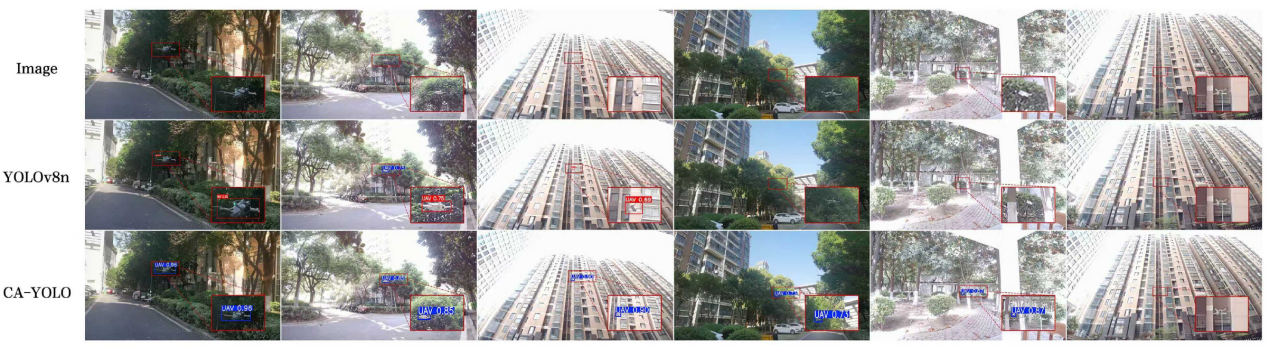

在视觉定位技术迈向智能化的过程中,研究团队提出的CA-YOLO仿生稳定定位系统以生物视觉机制为灵感源泉,实现了从传统检测范式到智能感知的跨越。该系统创造性地将生物视觉的精准聚焦特性与跨尺度特征处理智慧融入算法架构,通过创新设计的多维度注意力机制与专属目标检测模块,突破了小目标识别模糊、复杂背景干扰等长期困扰领域发展的技术瓶颈,让机器视觉具备了类似生物视觉的动态适应性与细节捕捉能力。

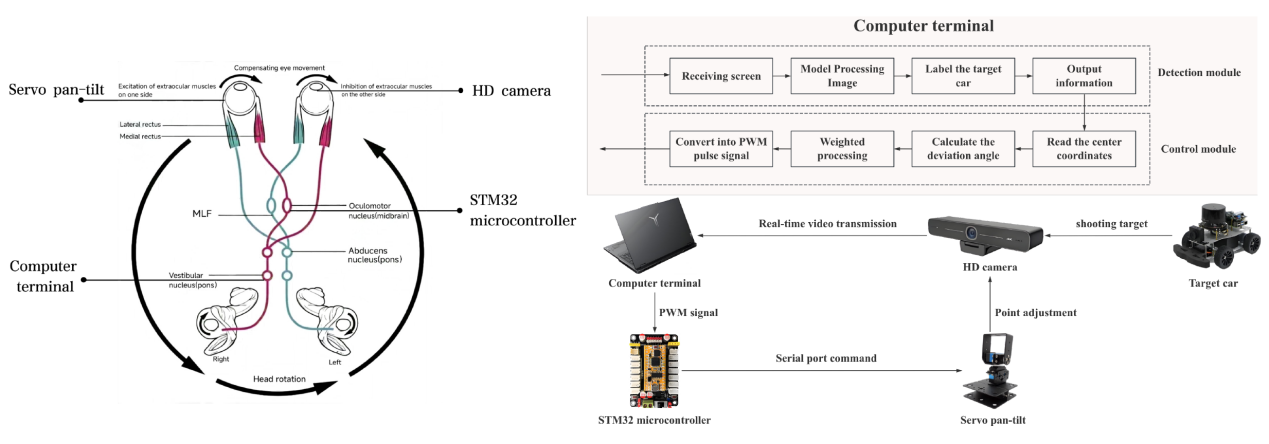

与此同时,研究团队受人类前庭眼反射机制启发构建的仿生机架控制系统,实现了从“被动跟踪”到“主动预判”的跃升,其动态调节策略完美复刻了生物视觉系统的稳定性与灵活性,使复杂环境下的目标跟踪达到前所未有的精准度与流畅度。这一融合生物智慧与工程创新的研究成果,不仅重新定义了视觉定位系统的性能边界,更为智能装备在动态场景中的感知与决策提供了全新的范式,引领该领域向更高层级的自主智能迈进。

图1 人类前庭眼动反射构造和仿生云台系统框架结构

图2 YOLOv8n 和 CA-YOLO 模型在不同场景下对AGV检测结果对比

图3 YOLOv8n 和 CA-YOLO 模型在不同场景下对UAV检测结果对比